그러나 음성 인식 AI는 말할 수 없고 들을 수 없는 청각·언어 장애인들에게는 무용지물이다. 이들을 위한 수화 인식 기능이 탑재된 AI 비서가 개발 중이다.

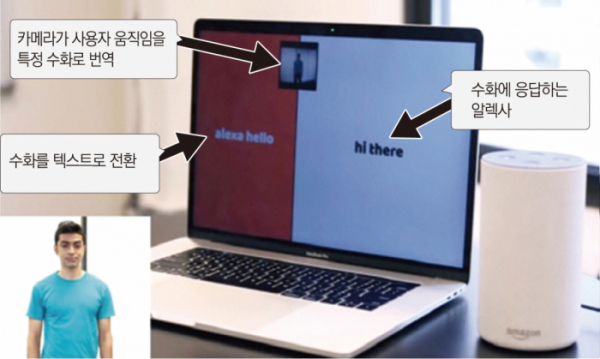

미국 IT 전문 매체 더버지는 최근 소프트웨어 개발자 아비쉑 싱이 아마존의 음성인식 AI 비서 알렉사가 탑재된 스피커 아마존 에코를 활용해 간단한 몸짓 언어 명령을 이해하는 기술을 개발했다고 보도했다. 싱이 직접 올린 튜토리얼 영상을 보면 에코를 웹 카메라가 장착된 노트북과 연결하고 그가 몇 가지 수화 동작을 하자 의미가 텍스트로 번역됐고 스피커를 통해 말로도 전달됐다.

싱은 구글의 AI 오픈 프로그램 텐서플로를 통해 기술을 구성했다. 자바 언어를 통해 시각적 표현을 인식하고 언어로 받아들이는 프로그램을 만든 것이다. 그는 더버지에 “음성 인식 비서들에게서 영감을 얻었다”며 “집과 직장 생활에서 음성 인식 장치들이 기본 바탕이 될수록 듣지 못하고 말하지 못하는 사람들을 위한 기술을 누군가는 생각해야 한다”고 전했다. 그러면서 “완벽한 디자인이란 본연 그대로를 담아내는 것”이라고 덧붙였다.

수화를 데이터화 해놓은 자료를 찾을 수 없었던 싱은 직접 기본적인 수화 표현들을 구성했다. 이렇다 보니 그가 개발한 프로그램은 아직 초기 단계라 적은 수의 단순한 수화를 인식하는 수준이다. 그러나 싱은 프로그램 코드를 오픈소스화하고 다양한 사용자들이 자발적으로 참여해 어휘 범위를 넓힐 수 있다고 설명한다.

이에 맞춰 아마존도 최근 자사 제품 에코쇼에 음성 없이 영상만으로 명령을 인식하고 작동하는 기술을 업데이트했다. 더버지는 아마존이 AI 비서에 접근할 수 있는 다양한 방식을 고민하기 시작했고, 수화 인식 기능이 앞으로 축적해 나가야 할 기술이라는 것을 인지했다는 뜻이라고 설명했다.

싱은 “아마존의 에코쇼나 다른 카메라가 탑재된 AI 비서가 이 (수화 인식) 기능을 더하지 못할 이유가 전혀 없다”고 말했다. 싱이 공개한 튜토리얼 영상만 봐도 수화 인식은 기술적으로 충분히 가능한 것임을 알 수 있다. 그는 “(수화 인식 기능은) 이 기술이 궁극적으로 활용돼야 하는 부분이라고 생각한다”고 거듭 강조했다.

![어떤 주담대 상품 금리가 가장 낮을까? ‘금융상품 한눈에’로 손쉽게 확인하자 [경제한줌]](https://img.etoday.co.kr/crop/140/88/2101515.jpg)

![2025 수능 시험장 입실 전 체크리스트 [그래픽 스토리]](https://img.etoday.co.kr/crop/140/88/2101156.jpg)

!["최강야구 그 노래가 애니 OST?"…'어메이징 디지털 서커스'를 아시나요? [이슈크래커]](https://img.etoday.co.kr/crop/140/88/2101671.jpg)

![[아시아증시] ‘트럼프 트레이드’ 한풀 꺾였나...닛케이 1.66%↓](https://img.etoday.co.kr/crop/85/60/2101701.jpg)

![[종합] 정부효율위 공동위원장에 머스크ㆍ라마스와미…트럼프, 두 사람 극찬](https://img.etoday.co.kr/crop/85/60/2101588.jpg)

![[정치대학] 박성민 "尹대통령, 권위와 신뢰 잃었다"](https://img.etoday.co.kr/crop/300/170/2101600.jpg)

![예결위, 비경제부처 예산심사 첫날 [포토]](https://img.etoday.co.kr/crop/300/190/2101714.jpg)