개보위 10월 ‘AI 프라이버시팀’ 신설…컨설팅 등 지원

‘AI 프라이버시 민·관 정책협의회’ 꾸려 현장과 대화

“국내ㆍ해외 사업자 역차별 문제 전혀 없을 것” 확언

고학수 개인정보보호위원회(개보위) 위원장이 생성형 인공지능(AI) 등에 개인정보가 안전하게 활용될 수 있도록 직접 발 벗고 나선다. 10월 ‘AI프라이버시팀’과 ‘AI 프라이버시 민·관 정책 협의회’를 신설하고, 회의에서 AI 기업과 학계 등을 만나 가이드라인 제정에 머리를 맞댄다. 특히 AI 스타트업 등을 지원하고, 국내 AI 기업이 해외 기업과 역차별 문제를 겪지 않도록 조성한다.

고학수 개인정보보호위원회 위원장은 3일 오전 정부서울청사에서 ‘인공지능(AI) 시대 안전한 개인정보 활용 정책 방향’에 대해 발표하며 “현장에서 느낄 수 있는 규제의 불확실성과 회색지대를 어떻게든 줄여나가겠다는 게 이 제도의 핵심 취지”라고 강조했다.

개보위는 10월 중 AI 프라이버시팀을 신설한다. AI 모델·서비스 개발 사업자와 소통하며 규제 샌드박스 적용 검토, 법령 해석 지원 등의 컨설팅 역할을 수행하는 개보위 내 AI 전담팀이다. 이와 함께 학계·법조계 전문가, 시민단체가 참여하는 AI 프라이버시 민·관 정책협의회를 구성한다.

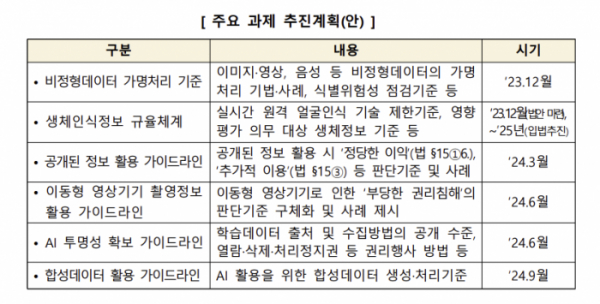

협의체는 회의를 통해 △비정형데이터 가명처리 기준 △생체인식정보 규율체계 △공개 정보 활용 가이드라인 △이동형 영상기기 촬영정보활용 가이드라인 △AI 투명성 확보 가이드라인 △합성데이터 활용 가이드라인 등을 마련한다.

고 위원장은 개인정보 활용 가이드라인이 자칫 기업에 규제로 작용할 수 있지 않느냐는 우려에 대해 “규제가 아닌 불확실성 해소”라고 일축했다.

이 과정에서 국내 기업과 해외 기업 간의 역차별 문제가 일어나지 않을 것이라고 단언했다. 고 위원장은 “해외 기업과도 전혀 문제 없이 의사소통이 진행되고 있다”며 “국내 사업자와 해외 사업자 간의 차등과 차별 문제는 전혀 없을 것”이라고 자신했다.

개보위는 개인정보 보호 강화 기술(PET) 연구개발(R&D)도 확대한다. 10월 ‘개인정보 안심구역’을 시범 운영해 기술을 검증할 수 있도록 한다. ‘AI 리스크 평가 모델’도 개발한다. 국제 협력도 강화한다. 개보위는 주요국의 감독기구와 공조 체계를 마련하고, 2025년 글로벌 프라이버시 총회(GPA)를 유치한다.

!['20년 째 공회전' 허울 뿐인 아시아 금융허브의 꿈 [외국 금융사 脫코리아]](https://img.etoday.co.kr/crop/140/88/2100022.jpg)

![[단독]"한 번 뗄 때마다 수 백만원 수령 가능" 가짜 용종 보험사기 기승](https://img.etoday.co.kr/crop/140/88/2100020.jpg)

![8만 달러 터치한 비트코인, 연내 '10만 달러'도 넘보나 [Bit코인]](https://img.etoday.co.kr/crop/140/88/2100256.jpg)

![환자복도 없던 우즈베크에 ‘한국식 병원’ 우뚝…“사람 살리는 병원” [르포]](https://img.etoday.co.kr/crop/140/88/2099863.jpg)

![불 꺼진 복도 따라 ‘16인실’ 입원병동…우즈베크 부하라 시립병원 [가보니]](https://img.etoday.co.kr/crop/85/60/2099872.jpg)

![[BioS]한미약품, 11일 기관투자자 대상 기업설명회 열어](https://img.etoday.co.kr/crop/85/60/2100453.jpg)

![[정치대학]이재명, 정치운명 가를 ‘운명의 주’…시나리오별 파장은?](https://img.etoday.co.kr/crop/300/170/2100294.jpg)

![하나금융그룹, '모두하나데이' 소외계층에 김장김치 1만1111포기 전달 [포토]](https://img.etoday.co.kr/crop/300/190/2100477.jpg)